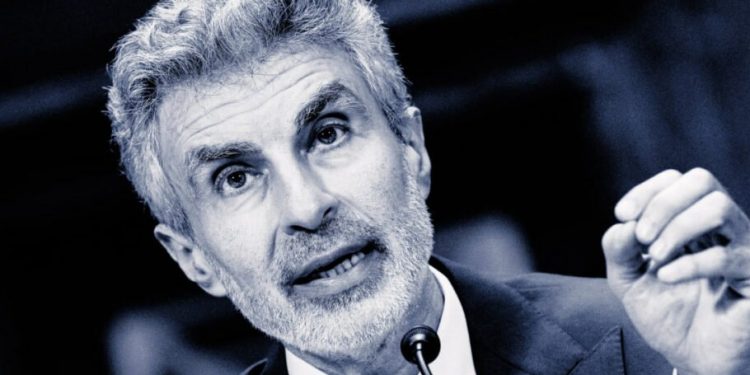

یوشوا بنجیو، یکی از پیشگامان برجسته هوش مصنوعی، به پروژه ای برای ایمنسازی این فناوری قدرتمند پیوسته است.

هدف اصلی این پروژه، که با نام Safeguarded AI شناخته میشود، توسعه سیستمهای هوش مصنوعی است که بتوانند امنیت سایر سیستمهای هوش مصنوعی را ارزیابی کرده و از بروز خطرات احتمالی جلوگیری کنند.

بنجیو که به عنوان مدیر علمی این پروژه فعالیت خواهد کرد، با تیم خود به دنبال یافتن راهکارهایی برای ایجاد مدلهای هوش مصنوعی قابل اعتماد و قابل پیشبینی هستند. این پروژه با حمایت مالی آژانس تحقیقات و اختراعات پیشرفته بریتانیا (ARIA)، به دنبال توسعه روشهای ریاضی و علمی برای تضمین امنیت سیستمهای هوش مصنوعی است.

یکی از چالشهای اصلی در حوزه هوش مصنوعی، اطمینان از اینکه این سیستمها طبق برنامهریزی عمل میکنند و خطرات غیرمنتظرهای ایجاد نمیکنند، است. روشهای سنتی مانند تستهای نفوذ، به تنهایی برای تضمین امنیت سیستمهای هوش مصنوعی پیچیده کافی نیستند.

پروژه Safeguarded AI با رویکردی نوآورانه، به دنبال توسعه ابزارها و تکنیکهایی است که بتوانند به طور دقیق و کمی، میزان امنیت یک سیستم هوش مصنوعی را ارزیابی کنند. این پروژه با تمرکز بر پایههای ریاضی و منطقی، به دنبال ایجاد یک چارچوب جامع برای ایمنسازی هوش مصنوعی است.

با توجه به گسترش روزافزون کاربردهای هوش مصنوعی در حوزههای مختلف، از جمله حملونقل، مراقبتهای بهداشتی و امنیت سایبری، اطمینان از امنیت این سیستمها از اهمیت بسیار بالایی برخوردار است. پروژه Safeguarded AI با حمایت از تحقیقات بنیادی در این زمینه، گامی مهم در جهت توسعه هوش مصنوعی ایمن و قابل اعتماد برداشته است.